- Convolution 종류

- deep learning

- object detection

- image classification

- Optimizer

- overfeat

- Weight initialization

- 딥러닝

- LeNet 구현

- SPP-Net

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |

- Today

- Total

목록Deep Learning (19)

I'm Lim

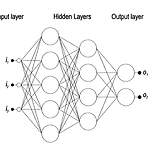

Multi Layer Perceptron

Multi Layer Perceptron

Paper Gardner, M. W., & Dorling, S. R. (1998). Artificial neural networks (the multilayer perceptron)—a review of applications in the atmospheric sciences. Atmospheric environment, 32(14-15), 2627-2636. 논문이 가지는 의미 인공지능망이 어떤 프로세스를 거쳐서 학습이 되는지 또 인공지능망을 적용한 예시 등을 보여줌으로써 기초적인 딥러닝의 학습방식을 이해할 수 있다. 논문의 내용 1. 딥러닝의 장점 1) 입력 데이터 분포에 대한 사전지식이 없어도 된다. 기존의 statistical model (e.g., Linear Regression, Logisti..

Back Propagation

Back Propagation

Paper Rumelhart, D. E., Hinton, G. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. nature, 323(6088), 533-536. 논문이 가지는 의미 퍼셉트론이 XOR문제를 해결하지 못하자 MLP가 등장하였고, 그에 따라 weight와 bias의 개수가 급등하였다. 이런 상황에서 weight update를 효율적으로 할 수 있는 방안이 필요했고, 그 중 하나가 Back-propagation 방식이다. 현재 딥러닝에서도 Back propagation을 이용하여 모델의 weight를 update시킨다는 점에서 중요한 논문이라 할 수 있다. 논문의 내용 1. Hidden layer..

The Perceptron

The Perceptron

Paper Rosenblatt, F. (1958). The perceptron: a probabilistic model for information storage and organization in the brain. Psychological review, 65(6), 386. 논문이 가지는 의미 최초의 Multi Layer Perceptron(MLP)에 대한 논문으로써 인공지능의 기원을 살펴볼 수 있다. 논문의 내용 1. 사람은 어떤 정보를 기억하는가? 1 ) One-to-one mapping : 어떤 정보를 고유의 코드화를 시켜서 저장한다는 것. 이 가설은 단순하여 임베딩이 쉽고, 직관적으로 이해하기 쉽다는 장점이 있다. 2 ) Central Nervous System (CNS) : 특정 정보를 임베..